人类通过视觉和语言感知世界。 人工智能的长期目标是构建智能智能体,通过视觉和语言输入了解世界,并通过自然语言与人类交流。例如,在《几行代码加速 Stable Diffusion,使用 OpenVINO 轻松文生图》中,我们介绍了使用OpenVINO运行Stable Diffusion模型来快速实现Vincent图应用。每个人都可以成为绘画大师,用AI随心所欲地画画。

随着计算机视觉和自然语言处理领域的快速发展,视觉与语言的融合越来越受到研究者的关注。在此背景下,BLIP(Bootstrapping语言-图像预训练)作为一种创新的预训练模型受到了广泛关注。该模型在大规模图像文本数据集上预训练深度神经网络模型,以提高图像文本检索、图像字幕和视觉问答等下游视觉语言任务的性能。通过联合训练图像和文本数据,为视觉和语言的融合提供了坚实的基础。

BLIP 的预训练过程涉及两个关键组件:图像编码器和文本编码器。图像编码器负责将输入图像转换为低维向量表示,而文本编码器则将输入文本转换为另一种低维向量表示。为了实现统一的视觉语言预训练,BLIP采用了跨模态约束策略,即在预训练阶段,将图像编码器和文本编码器设计为相互约束。这样的约束机制迫使模型学习将视觉信息与语言信息对齐,使得模型在后续任务中能够更好地处理视觉和语言之间的联合信息。

除了视觉语言理解任务之外,BLIP 在视觉语言生成任务中也表现良好。在此任务中,模型需要根据输入图像和文本生成相关描述或回答问题。 BLIP联合训练并引入图像文本生成任务,赋予模型更强大的图像描述和问答能力。这使得BLIP能够在图像描述生成和视觉问答等任务上取得优异的结果。

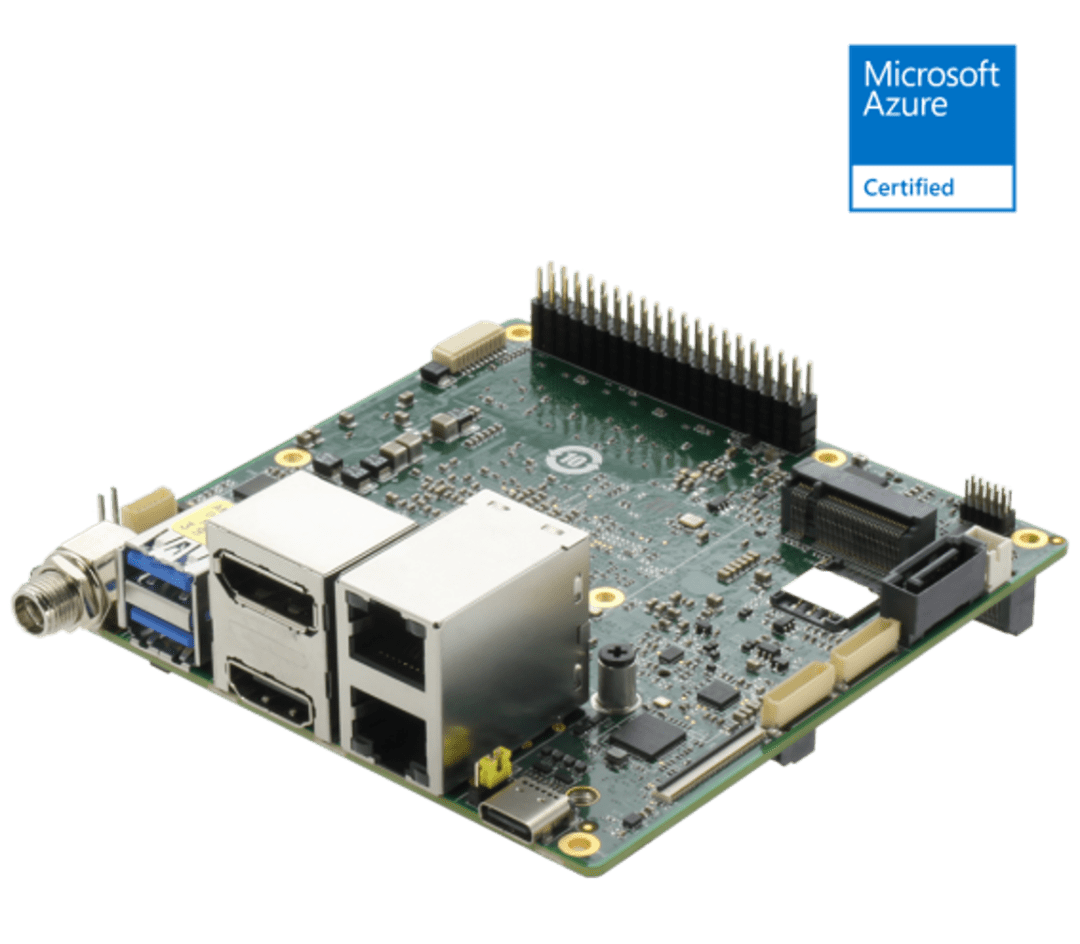

接下来,我们来看看如何在研扬科技新产品UP Squared Pro 7000 Edge上使用OpenVINO优化和加速BLIP推理的关键步骤。